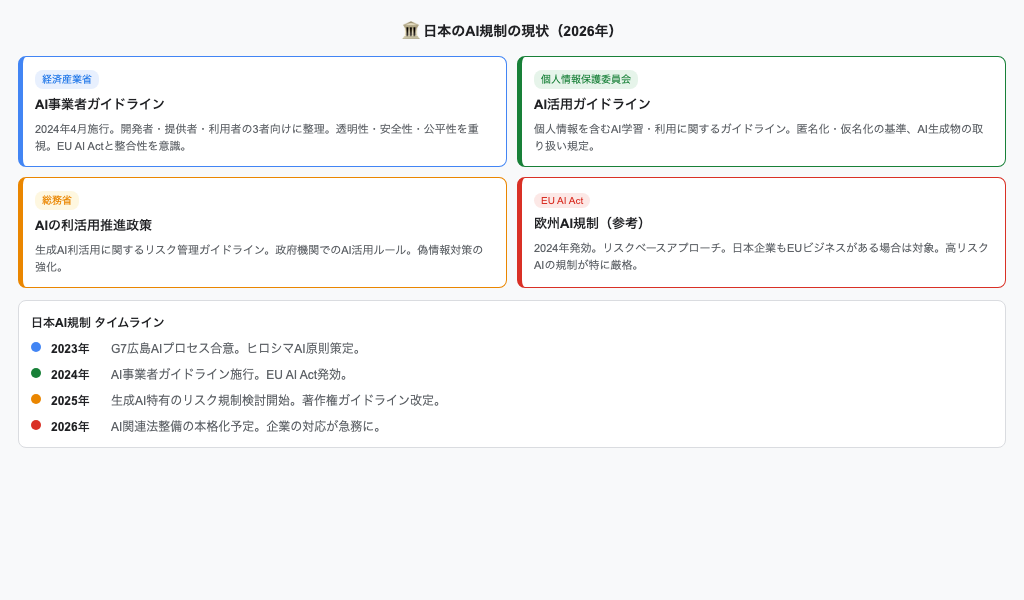

日本のスタンス:ソフトロー中心

日本は法律による強制ではなく、省庁のガイドラインや自主規制を軸にした「ソフトロー」アプローチを採用。イノベーション促進と安全確保のバランスを重視する。

EU AI Act(ハードロー)との違い

EUは2024年施行のAI規制法でリスクレベルに応じた義務を法的拘束力を持って課す。日本はまだ包括的なAI法は存在しない。

| 項目 | 日本 | EU |

|---|---|---|

| 規制形式 | ソフトロー | ハードロー |

| 罰則 | 原則なし | 最大3,500万€ |

| 義務化 | 任意・推奨 | リスク別に義務 |

| 施行状況 | ガイドライン整備中 | 2024年段階的施行 |

| 重点 | イノベーション優先 | 安全・基本権保護 |